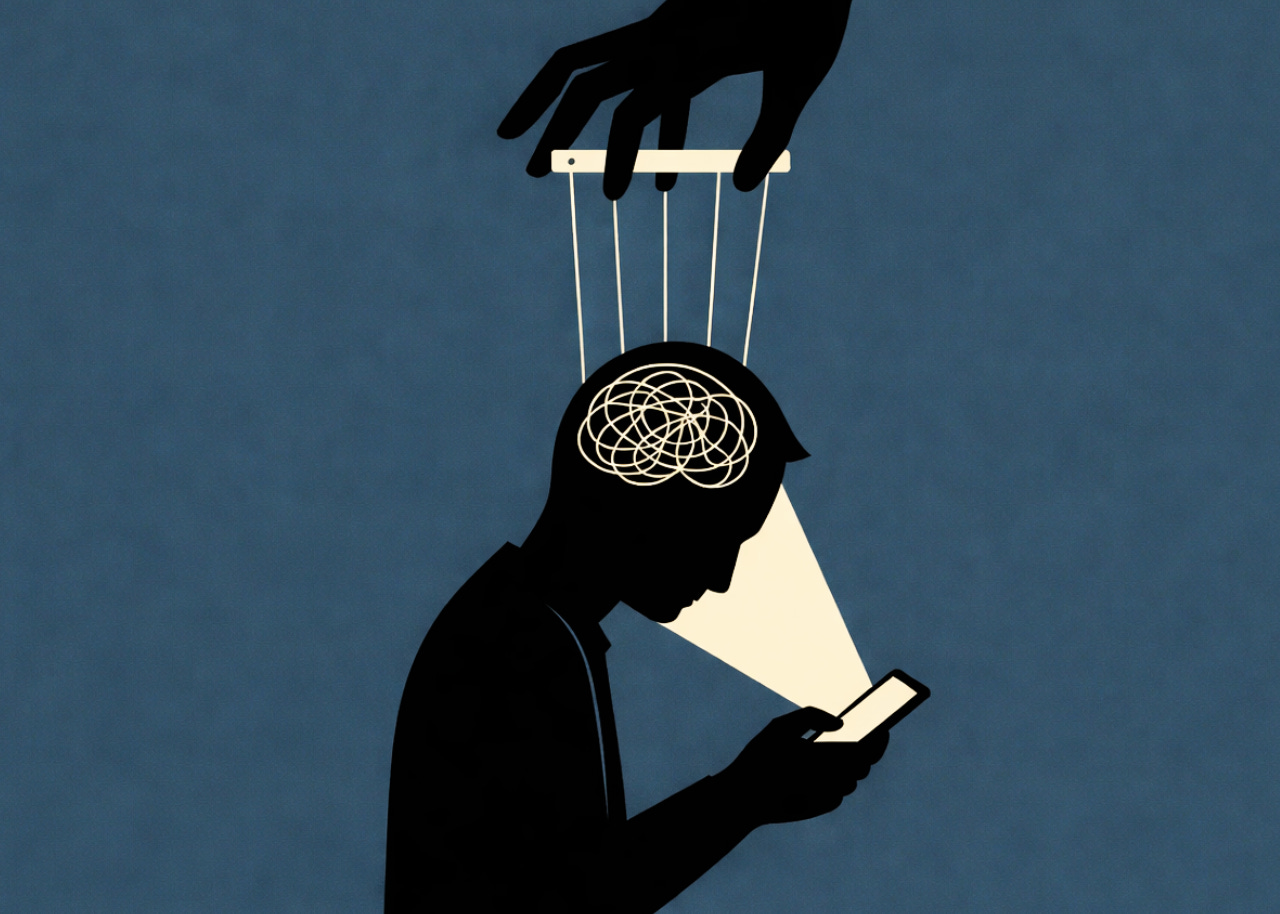

"Para ti": Cómo los algoritmos dictan tu visión del mundo

La realidad detrás del contenido recomendado

🏷️ Categorías: Toma de decisiones y sesgos, Atención.

Cuando empecé a escribir en Internet, me fascinaba la idea de amplitud.

Substack era una ventana no convencional al mundo entero. Opiniones opuestas, culturas lejanas, ideas que nunca habría descubierto en mi entorno inmediato. “Qué bueno”, decía, “un sitio que no me devuelve lo que ya pienso”.

Pero algo ha cambiado.

Hoy, en lugar de abrir ventanas, se ha convertido en un espejo. Un espejo pulido, diseñado por algoritmos, que no muestra el mundo, sino una versión editada de lo que ya pensamos, lo que ya creemos, lo que ya hemos clicado antes. La función de Substack Notes es otro Twitter más, un Tiktok más, otro espejo más.

Y lo más inquietante es que esta sea la tendencia global.

Hoy vamos a ver cómo los algoritmos moldean tu visión de la realidad, empobrecen la democracia y, en última instancia, pueden decidir el futuro de países.

Sí, así como lo oyes

La burbuja de filtros

La primera advertencia llegó en el año 2010.

Eli Pariser, activista por el uso libre de internet, acuñó un término que hoy deberíamos recordar: “burbuja de filtros”. Se refiere a ese “universo personal de información” que te rodea cada vez que entras a internet. Se refiere a esa visión perfectamente recortada para encajar en tu forma de pensar que todas las apps ofrecen.

Facebook, Google, Instagram, Twitter, TikTok… está en todas partes.

El funcionamiento es simple, al usar su servicio, analizan tu comportamiento, lo miden con datos que recogen cuando aceptas las “cookies” y luego deciden qué mostrarte.

Facebook dejó de mostrarle a Pariser las publicaciones de algunos de sus amigos porque él solía clicar en las de otros, lo que hizo que se volvieran invisibles.

Google personaliza incluso resultados de la misma búsqueda. Dos personas escriben “Egipto” al mismo tiempo, y una ve turismo como opción predominante mientras que la otra ve protestas políticas y datos económicos.

TikTok llevó esto al extremo: ya no tienes que buscar nada. El algoritmo decide qué verás. Tú solo deslizas el dedo con total pasividad.

Lo que antes era una “dieta informativa” mixta —un poco de verdura, un poco de carne, un postre— es ahora una sola comida: todo el día tu plato favorito.

Al igual que esa dieta desequilibraría tu cuerpo, sucede con tu mente.

El papel del usuario

Es tentador culpar solo a los algoritmos, pero nosotros los alimentamos.

Un estudio de Bakshy et al. (2015) con 10 millones de usuarios de Facebook mostró algo revelador: el algoritmo reducía la exposición a noticias contrarias un 10%, pero eran los propios usuarios quienes la reducían aún más, al seguir cuentas que reforzaban su visión e invisibilizaban las contrarias.

Vemos menos diversidad porque el sistema lo decide y porque lo preferimos.

Preferimos confirmar lo que ya creemos porque es más cómodo que te digan que tienes razón que cuestionar lo que siempre habías pensado. La psicología tiene un nombre para esto: sesgo de confirmación. Y la tecnología lo ha hecho negocio.

Nicholas Carr lo advirtió en su libro Superficiales, del que ya hicimos un análisis.

“Los medios que usamos acaban moldeando nuestra mente.”

Cada clic entrena al algoritmo.

Cada like predice lo siguiente que verás.

Cada scroll te hace estar cada vez más seguro de tus creencias.

Un mundo donde todo te da la razón es un mundo donde jamás se aprende.

El poder de los algoritmos

Hasta aquí, podría parecer un problema individual, pero es que es colectivo.

Los datos demuestran que el impacto es político, masivo y silencioso.

En 2015, Robert Epstein demostró con casi 5000 votantes indecisos que un simple sesgo en los rankings de Google podía cambiar las preferencias electorales hasta un 80% en grupos vulnerables. Lo que el algoritmo mostraba (y ocultaba) en los últimos días fue crítico para desplazar la intención de voto.

Lo más inquietante es que esta clase de manipulación es invisible.

Al ser nosotros quienes buscamos y no haber nadie al otro lado, no percibimos que lo hallado en internet pueda estar sesgado ni que otras fuentes queden invisibilizadas. Si una cadena de televisión podía sesgar la opinión pública, imagina cuando una sola empresa controla el 90% de las búsquedas de un país…

Es el gran poder de los algoritmos frente a medios de comunicación previos.

Pero el efecto no termina ahí: crea la ilusión de unanimidad.

El riesgo de estas cámaras de eco es que pierdes la capacidad de criticar otros puntos de vista, ignoras riesgos y sientes que el consenso equivale a verdad. Y lo más siniestro es que ocurre mientras entregamos datos de nuestra vida cotidiana a cambio de esta “personalización”. Lo que alguna vez fue un espacio anónimo hoy es una máquina que sabe qué compras, qué lees en Kindle, qué páginas marcas, hasta qué dudas íntimas consultas en un buscador.

Trato simple: entretenimiento y comodidad a cambio de tu privacidad.

La ética de los algoritmos

Eli Pariser lo resume con una idea que da para pensar…

Si los algoritmos se han convertido en nuestros nuevos editores de contenido, ¿quién decide entonces qué merece ser visto y qué queda oculto? ¿Quién establece qué es relevante y qué no? Hoy no son ya los medios tradicionales, la prensa o la televisión, quienes cumplen ese rol, ahora son las grandes tecnológicas, que definen la “ética” de los algoritmos y determinan qué priorizar y qué invisibilizar para tus ojos.

Al final, los algoritmos solo entienden de clics: dependerá de intereses, decisiones y valores de los humanos detrás de ellos los que marcan la diferencia.

Salir de la burbuja no es cómodo.

Pero la incomodidad es el precio de la libertad.

¿Sigues con curiosidad? Aquí va una selección con 3 artículos relacionados.

Deja de ver las noticias: Ideas sobre el ruido y la búsqueda de profundidad

¿Son realmente tuyas tus opiniones? El trabajo que de tener opinión propia

✍️ Te toca a ti: ¿Qué pasos concretos podrías dar hoy para ampliar la diversidad de tu consumo informativo?

💭 Cita del día: “Hay muchísimas cosas en este mundo nuestro sobre las que aún no has empezado a preguntarte”. — Roald Dahl, James and the Giant Peach.

¡Nos vemos en la próxima! 👋

Referencias 📚

Bakshy, E., Messing, S., & Adamic, L. A. (2015). Exposure to ideologically diverse news and opinion on Facebook. Science, 348(6239), 1130-1132. URL

Epstein, R., & Robertson, R. E. (2015). The search engine manipulation effect (SEME) and its possible impact on the outcomes of elections. Proceedings Of The National Academy Of Sciences, 112(33). URL

Pariser, E. (2011). The filter bubble: How the New Personalized Web Is Changing What We Read and How We Think.

Es tal cual lo comentas. Al final, la gente deja de pensar y acepta un pensamiento impuesto por otro. Además el algoritmo te sirve para polarizarte en vez de encontrar un punto medio de ambos extremos.

Espectacular hablar de este tema. Y como lo haz expuesto. Gracias 👏🏼ñ